Hay algo incómodo en la historia reciente de Vercel. No porque sea un caso aislado, sino porque expone con crudeza algo que vengo viendo hace meses en múltiples organizaciones: la adopción de inteligencia artificial está avanzando mucho más rápido que la capacidad de gobernarla.

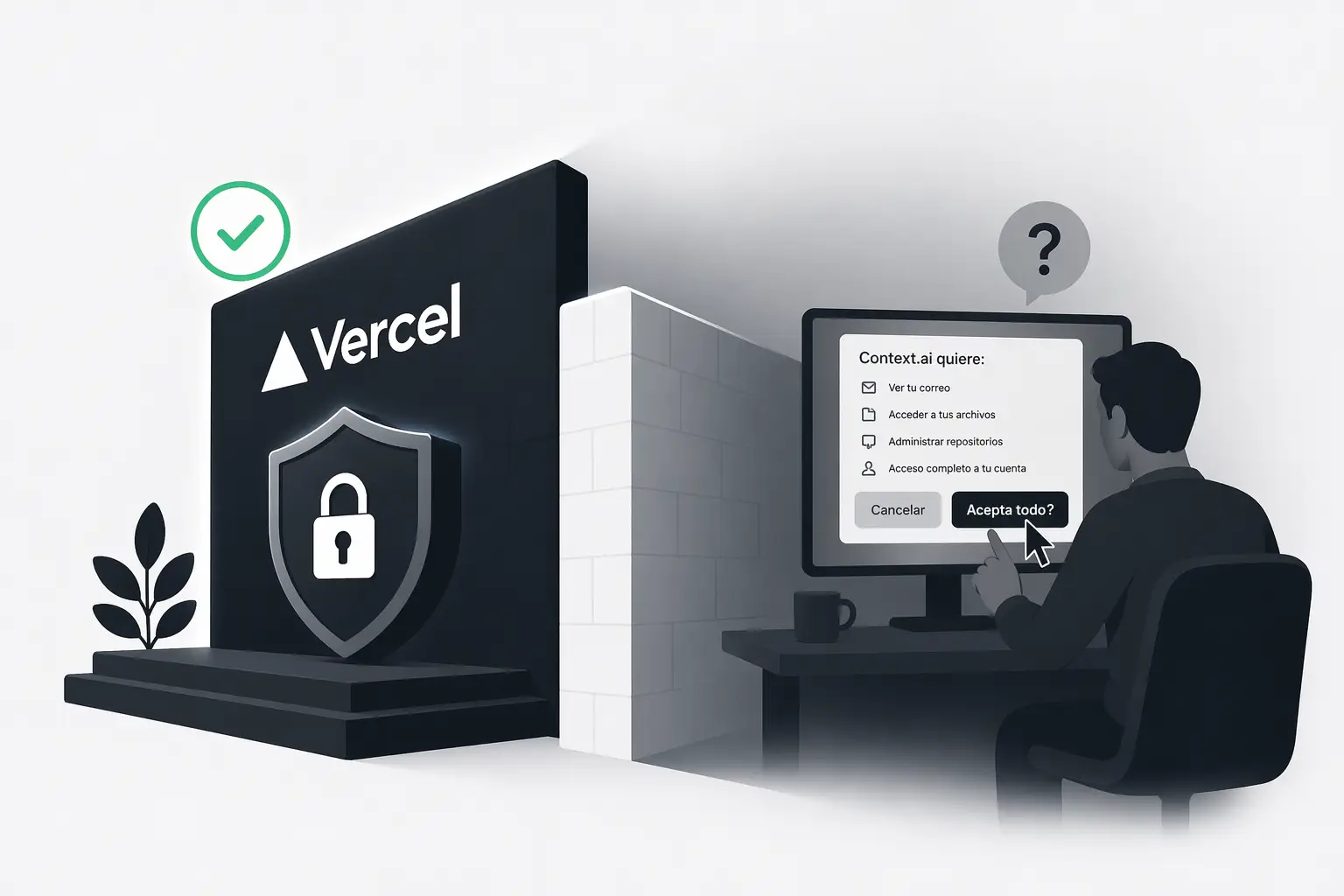

Lo que se ha comentado sobre el incidente es, en esencia, un problema de permisos y confianza mal gestionada. Un empleado conecta una herramienta de IA a su cuenta corporativa, probablemente buscando ser más productivo. Autoriza accesos amplios, como suele pasar con OAuth cuando nadie revisa en detalle qué se está concediendo. Esa herramienta, o su entorno, se ve comprometido. Y en ese momento, el atacante no necesita “hackear” la empresa en el sentido tradicional: ya tiene la llave.

Eso cambia completamente la lógica de seguridad. Ya no se trata solo de proteger infraestructura o endpoints, sino de entender que cada integración es una extensión de tu perímetro. Si una herramienta externa hereda permisos sobre correo, repositorios, sistemas internos o APIs, entonces esa herramienta pasa a ser parte de tu cadena de confianza. Y si cae, tú caes con ella.

El problema no es el error de una persona. Es el contexto en el que ese error es posible.

Hoy existen miles de aplicaciones de IA, y crear una nueva es cada vez más fácil. Con unas pocas APIs, un frontend simple y un modelo base, cualquier equipo —o incluso una sola persona— puede lanzar una herramienta funcional en días. Pero la facilidad para construir no viene acompañada, necesariamente, de buenas prácticas de seguridad. Muchas de estas aplicaciones no tienen procesos robustos de gestión de credenciales, no cifran adecuadamente la información o no están diseñadas para operar en entornos corporativos con estándares altos.

Y sin embargo, las empresas las están adoptando igual.

Esto es lo que se conoce como “shadow AI”. Equipos que, con la mejor intención, empiezan a usar herramientas externas para ganar eficiencia. Marketing conecta un generador de contenido a Google Drive. Desarrollo prueba una plataforma que se integra con GitHub. Finanzas automatiza reportes con una app que pide acceso a correos. Todo ocurre por fuera de un marco formal, sin evaluación, sin políticas, sin visibilidad.

Desde el punto de vista del negocio, es comprensible. La presión por “usar IA” es real. Nadie quiere quedarse atrás. Pero desde el punto de vista de riesgo, es una bomba de tiempo.

El caso de Vercel pone sobre la mesa algo clave: la seguridad ya no depende solo de lo que tú desarrollas o despliegas, sino de todo lo que conectas. Cada autorización amplia es, en la práctica, una posible escalada de privilegios para un tercero. Y cuando eso se combina con credenciales expuestas, tokens mal gestionados o integraciones encadenadas, el impacto puede ser sistémico.

He visto organizaciones donde nadie puede responder con certeza una pregunta básica: ¿qué aplicaciones de IA están hoy conectadas a nuestras cuentas corporativas? Y si no puedes responder eso, tampoco puedes gestionar el riesgo.

El punto no es dejar de usar herramientas de IA. Eso sería un error estratégico. La IA sí genera valor, y en muchos casos lo hace de forma muy tangible. El punto es dejar de adoptarla de manera improvisada.

Adoptar IA correctamente implica tomar decisiones. Definir qué casos de uso tienen sentido, qué datos pueden utilizarse, qué herramientas cumplen con estándares mínimos, cómo se gestionan los accesos, cómo se auditan las integraciones y qué ocurre cuando algo falla. Implica entender que la productividad no puede venir a costa del control.

También implica cultura. No basta con bloquear herramientas o restringir accesos. Si la organización no ofrece alternativas seguras y alineadas con el negocio, las personas igual van a buscar soluciones por fuera. El shadow AI no aparece porque sí, aparece porque hay una necesidad no resuelta.

Por eso, más que hablar de herramientas, hay que hablar de estrategia y gobierno. De cómo se decide qué usar, cómo se usa y bajo qué condiciones. De cómo se equilibra velocidad con seguridad. De cómo se construye una base que permita escalar el uso de IA sin exponerse innecesariamente.

El incidente de Vercel no es una anomalía. Es una señal.

Las empresas que entiendan esto a tiempo van a poder capturar el valor de la IA de forma sostenida. Las que no, probablemente van a aprenderlo por las malas.

En fuubo trabajamos justamente en ese punto intermedio donde hoy muchas organizaciones están perdidas: entre la urgencia por usar IA y la necesidad de hacerlo bien. Ayudamos a entender el nivel real de madurez, a identificar riesgos invisibles como el shadow AI y a construir una estrategia que permita avanzar sin comprometer el negocio.

Si hoy no tienes claridad sobre qué herramientas de IA se están usando en tu empresa, qué permisos tienen o qué riesgos implican, probablemente es un buen momento para mirarlo con más detalle. Puedes partir con nuestro assessment de madurez en IA y tener una primera fotografía de dónde estás realmente. A partir de ahí, se puede empezar a construir sobre una base mucho más sólida.